相信大家都有玩過 Facebook 3D 相片功能,只要拍一張照片就能做出有輕微 3D 效果。不過細心看就會發現相片有不少瑕疵,而光影反射也是固定了的,不太真實。早前加州大學柏克萊分校和聖地牙哥分校就與 Google Research 合作,開發出一套名為手 NeRF 的技術,透過新的神經網絡機械學習,就能生成可以自由地從不同角度來觀看的立體照片,非常像真。

NeRF 使用一種名為 MLP (多層感知)神經網絡來學習,沒有使用一般機械學習生成影像時所用的卷積神經網絡( CNN, Convolutional Neural Network ),而產生出更高精度的結果。

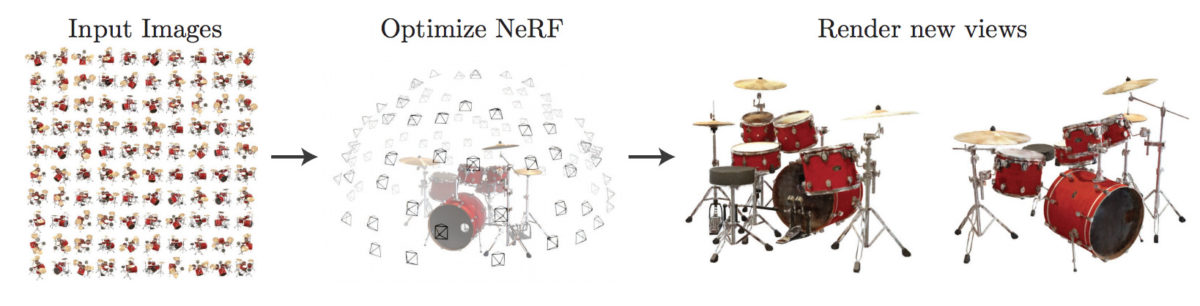

研究人員從不同角度拍攝 20-50 張目標物件的照片,將各照片拍攝的 3D 座標和 2D 視線方向資料輸入,讓人工智能去預測不同視角的物體密度和 RGB 色彩,從而合成出新的連續影像。合成出來的影像,連光的反射方向都能重現,觀察者變更觀看角度時,反射程度也會同時改變,令影像看來來更加真實自然,更具立體感。

▲ 改變觀察視角時,連房間背後電視的反光都會跟隨移動(左),相當迫真。

此外,研究人員更可以在生成出來的影像主體前後放入虛擬物件,虛擬物件能按照觀察角度而被前景的物件遮蓋,就像虛擬物件真的存在於照片當中。

想更進一步了解 NeRF 技術的利害之處,可以欣賞以下影片介紹。