微軟與 OpenAI 合作在 Bing 搜尋服務加入人工智能 ChatGPT,迫得 Google 行政總裁 Sundar Pichai 提早在 2 月 6 日(星期一)劇透旗下的 AI 對話機械人 Bard 。當眾人期望 Google 在巴黎辦的發表會示範 Bard 作為回應 AI 對話的競爭時,結果只得數分鐘介紹。發表會的主角卻是去年 Google I/O 已亮相的 Lens 程式,將新增多重搜尋功能,以及地圖服務實景導覽。

發表會由 Google 高級副總裁 Prabhakar Raghavan 主持,關於近期熱話的生成人工智能,他提到現時廣泛採用的 Transformer 神經網絡架構,是 Google 軟件工程師 Jakob Uszkoreit 在 2017 年發表的作品。2021 年用 Transformer 神經網絡架構開發超大型語言模型 LaMDA,2022 年推出 LaMDA 2,後者亦即被指是擁有認知能力的 AI 。

Raghavan 介紹的對話式人工智能服務 Bard,基於 LaMDA 模型開發。他稱,Bard 用 LaMDA 強大能力實時整理全球的知識,回答用戶問題。可以問 Bard 複雜的問題,得到創意的答案。不過, Bard 現時僅開放給 Google 可信的測試人員使用。

Google 將引入更多生成式 AI 技術,例如在搜尋回答開放式問題,以及用平面照片產生 360 度影像。不過 Raghavan 未有提及推出時間,而且這些 AI 相關的功能只有影片示範,未有即場展示技術。

Lens 升級多重搜尋

這次發表會主角其實是升級版 Lens 程式。他說,Lens 程式每月有超過 100 億次搜尋,成了用戶主要的搜尋方式。升級的 Lens 加入「搜尋畫面」功能,用戶在網站、程式內的相片或影片都可搜尋。

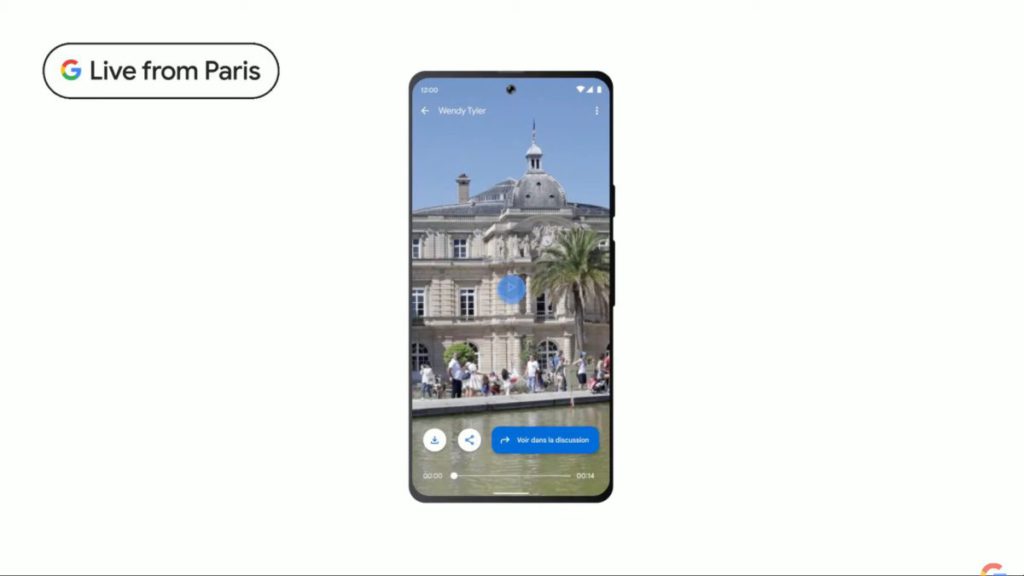

從 Android 電話的示範,朋友傳來旅遊時拍攝的影片,按鍵召喚 Google Assistant ,選擇搜尋畫面, Lens 程式即時辦認影片內的建築物,提供相關的搜尋結果。這功能預計幾個月內才會在 Android 電話推出。

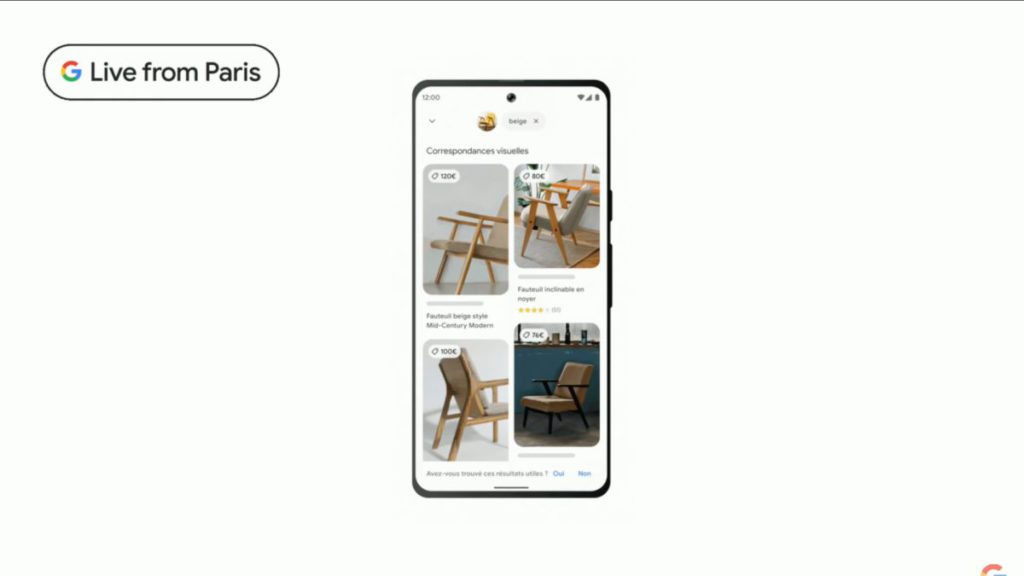

Lens 程式又加入多重搜尋(Multisearch)功能,同時用圖片和文字搜尋。例如經 Lens 程式拍攝椅子,加入文字「黃色」,搜尋條件變成「黃色 + 椅子」。同時又加入地點搜尋,如「在我附近」(near me),能夠搜尋附近哪間商戶有 Lens 程式拍攝的產品。這功能在去年的 Google I/O 已示範過,今日先在美國推出,也先支援英文,之後陸續推至全球。

地圖推出實景導覽

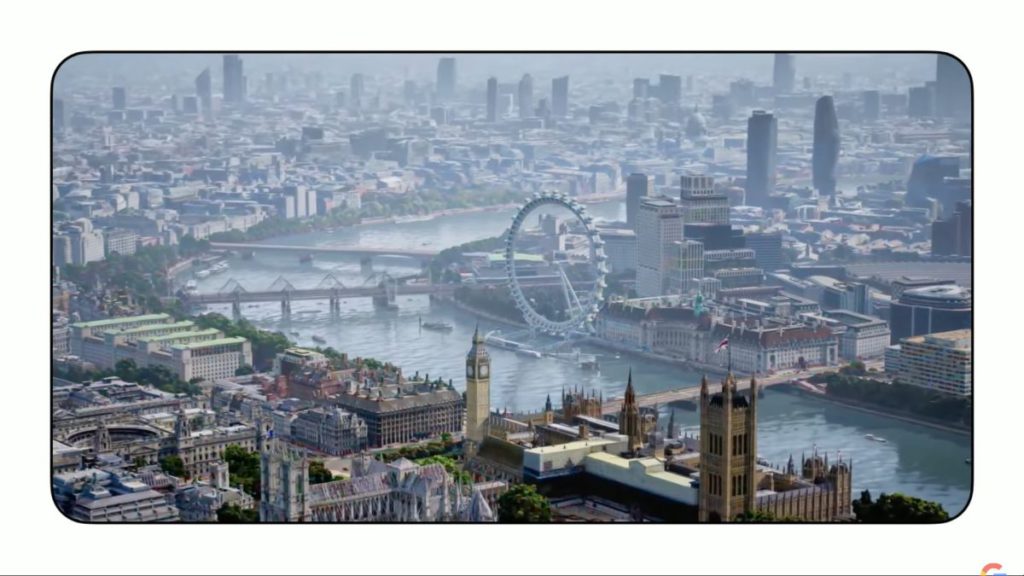

地圖服務則正式推出實景導覽(immersive view),從平面地圖用 AI 運算變成 3D 地圖,甚至從街景導覽走入餐廳。這功能先在倫敦、洛杉磯、紐約、三藩市和東京推出。

地圖服務亦擴大室內實景和導航功能,目前已支援美國、蘇黎世、東京等地區,之後會加入台北、新加坡、雪梨、墨爾本、倫敦、柏林、巴黎、巴塞羅拿、法蘭克福、馬德里、布拉格和聖保羅等地的逾千機場、火車站和商場。